LM Studio 0.3.6

LM Studio 0.3.6 通过 LM Studio 的 OpenAI 兼容 API 引入了函数调用/工具使用 API。

这意味着您可以使用 LM Studio 与任何目前知道如何使用 OpenAI 工具的框架,并转而使用本地模型进行工具使用。此功能处于测试阶段,我们非常希望收到您的错误报告和反馈。

除了此 0.3.6 版本中的其他新功能外,还支持新的视觉输入模型:Qwen2VL 系列 + Qwen/QVQ(大型视觉 + 推理模型),可在 LM Studio 的 MLX 和 llama.cpp 引擎中使用。

临时说明:0.3.5(稳定版)的应用程序内更新将在本周晚些时候启动,因为我们正在过渡到新的更新系统。LM Studio 0.3.5 b10 及更新版本的更新已全面运行。手动安装 LM Studio 以获取最新版本。

🔔 注册我们的邮件列表,获取 LM Studio 发布通知。

LM Studio 0.3.6 的新功能

本次发布的一个亮点是,我们已经自动化了整个构建和发布流程,这意味着发布新的 LM Studio 应用程序和引擎更新将变得更加容易。我们对此感到非常兴奋。

请参阅下面的完整发布变更日志,了解新功能和错误修复。

工具调用 API(测试版)

- 新 API:OpenAI 函数调用/工具使用 API 的直接替代品

- 支持

llama.cpp和MLX模型 - 支持流式和非流式

- 支持

- 工具使用文档可在以下网址获取:https://lm-studio.cn/docs/advanced/tool-use

- 通过类似 OpenAI 的 API 使用任何支持工具使用和函数调用的 LLM

- Qwen、Mistral 和 Llama 3.1/3.2 模型在工具使用方面表现良好

- 应用程序内代码片段中包含入门代码

- 通过流式和非流式工具使用的采样配置,提高了工具调用可靠性

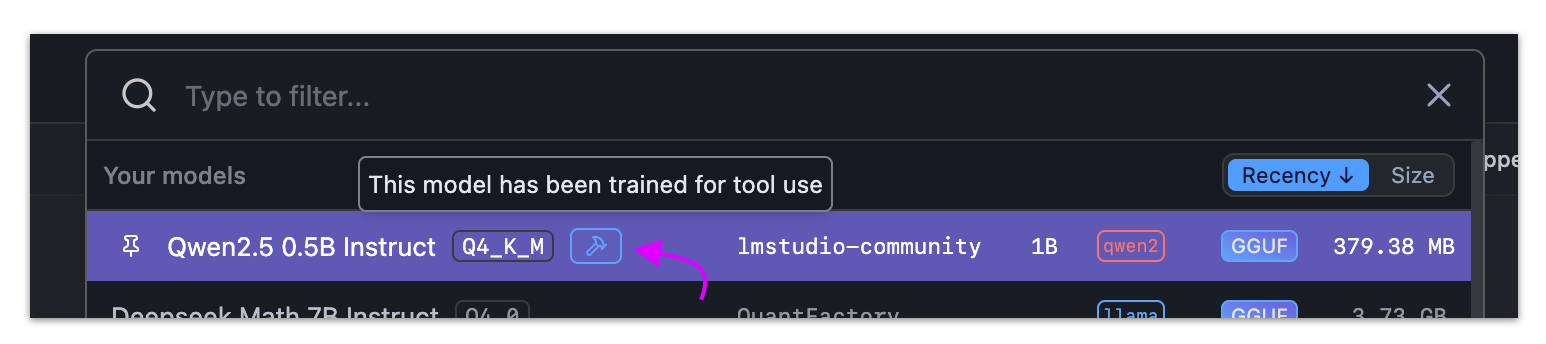

一个指示模型已针对工具使用进行训练的徽章

新视觉输入模型

- 在 GGUF 和 MLX 中添加了对 Qwen2VL (2B, 7B, 72B) 和 QVQ (72B) 的支持

- 添加了对 .webp 图像的支持

- 添加了视觉模型输入的图像自动调整大小功能,硬编码为 500 像素宽度,同时保持纵横比

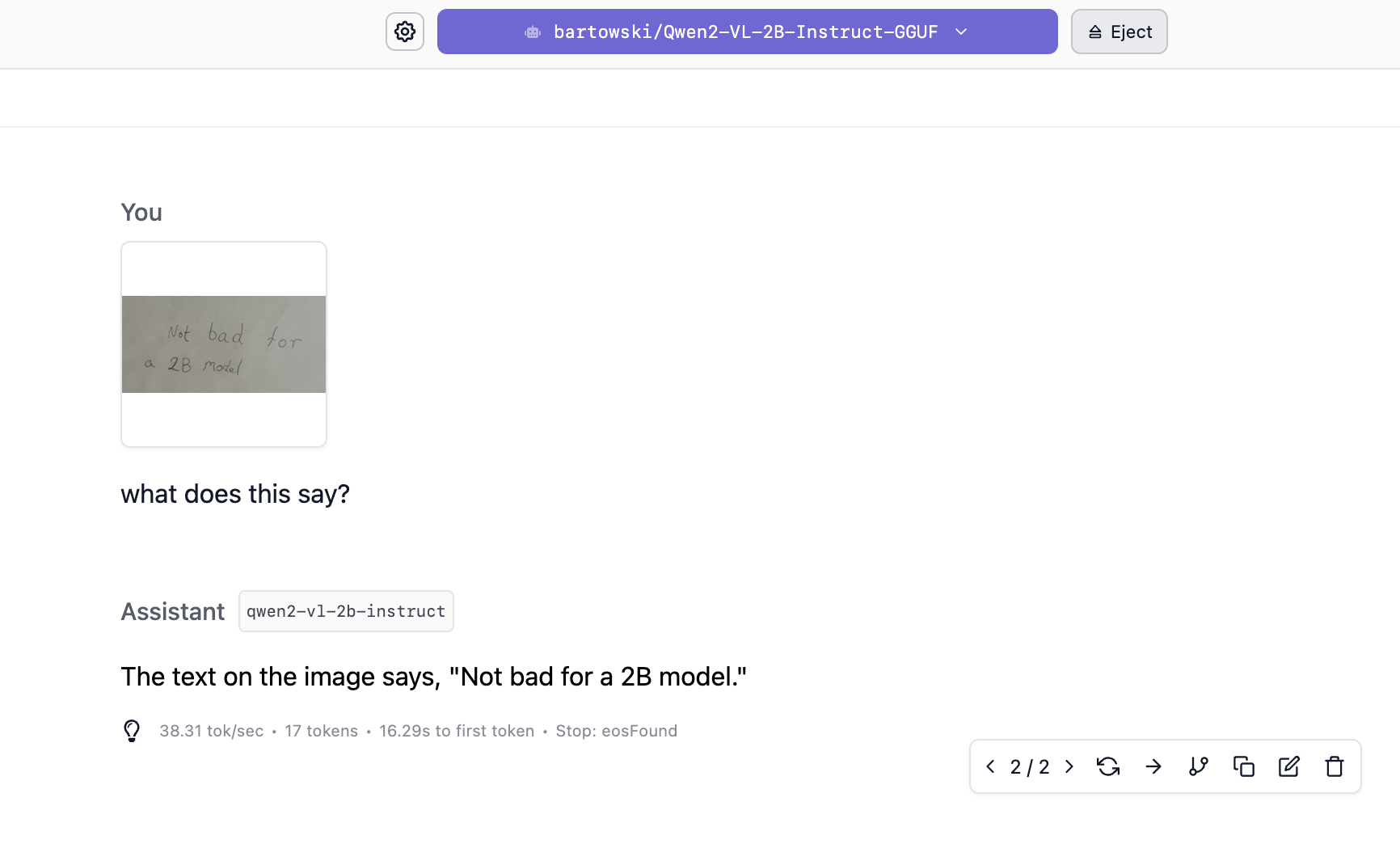

一个 2B Qwen2VL 视觉输入模型,可识别简单的手写

新的和改进的安装程序

- 在 Windows 上:您现在可以选择安装驱动器和目录!

- 在所有平台上:全新的 LM Studio 应用程序内更新系统

- 订阅稳定版或测试版更新。测试版更新将更频繁地发布。

- 注意:以前的发布渠道不起作用。现在它们可以了。

- 订阅稳定版或测试版更新。测试版更新将更频繁地发布。

- 应用程序更新不会重新下载数百兆字节未更改的依赖项,并且通常会更小、下载速度更快。

- 我们已经确定了使这些文件更小的领域

- 下载应用程序内更新时的进度条

订阅 Beta 频道以获取更频繁的 LM Studio 更新

LM 运行时改进

- 改进的 LM 运行时发布系统(llama.cpp、MLX 等)

- 这已经实施了一段时间,但我们已经使这个过程中的几乎所有事情都自动化了。

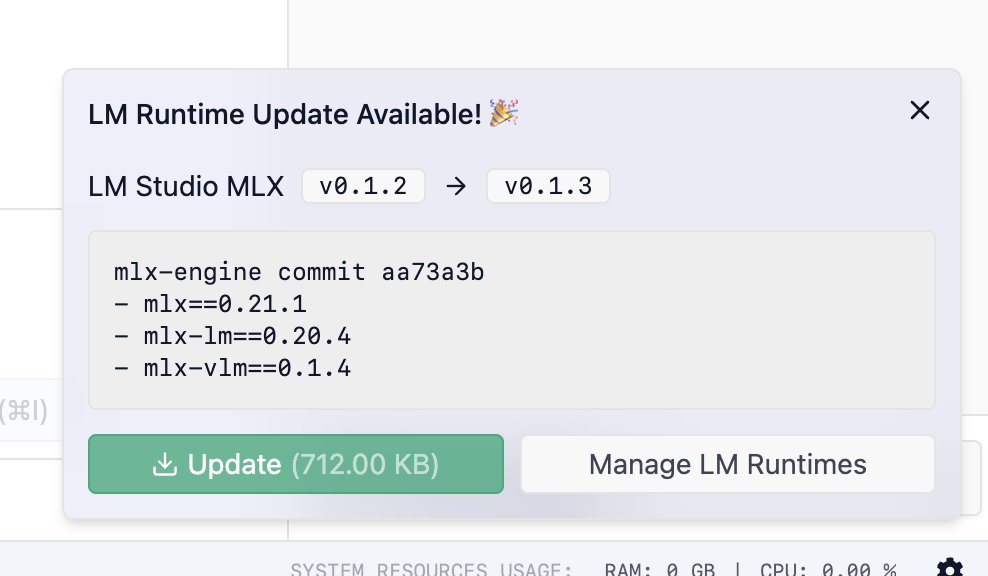

- 当新的 llama.cpp / MLX 版本可供下载时,应用程序内通知

- 不会需要完整的应用程序更新

- 添加了“缺少库”运行时兼容性状态,允许用户“修复”安装不正确的运行时

在大多数情况下,无需等待 LM Studio 应用程序更新,即可在更新可用时立即更新您的 llama.cpp 或 MLX 引擎

UI 改进

- 聊天侧边栏 UI 改进

- 服务器页面 UI 改进

- 更新后在应用程序中显示发布说明

- 添加了一个设置选项,即使生成速度缓慢,也始终使用 LLM 生成标题

MLX 更新(Apple Silicon)

- 提高了 MacOS 15 的性能

- 提高了 VLM 的性能

- 提高了长上下文生成的性能

- 提升 mlx-engine 依赖版本:

mlx==0.21.1,mlx_lm==0.20.4,mlx_vlm==0.1.4 - 支持 MLX 模型的 3 位和 6 位量化

开发者体验

- 新的应用程序内“快速文档”,包含代码片段和工具使用示例(右上角)

- 在新窗口中打开,以便在 LM Studio 中并排使用

- 改进了服务器 API 中的错误报告

- 按

cmd/ctrl+shift+J可将服务器日志弹出到新窗口- 在聊天页面也可用

- 对于高级用户:LM Studio 的主目录已从历史的

~/.cache/lm-studio移至新的~/.lmstudio。- 这仅对首次安装有效。

- 如果您在

~/.cache/lm-studio中已有数据,应用程序将不会尝试移动它。

错误修复

- 修复了使用

/completionsAPI 端点时“inputConfig required to render jinja prompt”的问题 - 修复了首次模型下载时出现空白屏幕的问题

- 修复了在 Windows 上为所有用户安装应用程序时运行时未正确设置的问题

- 错误修复:将

tool_call_id设置为可选 - 修复了 Qwen2VL 和其他模型的 jinja 模板处理错误

- 修复了更新后未选择较新 LM 运行时的问题

- 修复了在聊天名称字段编辑时点击会取消重命名的问题

- [Mac] 修复了向支持视觉功能的模型发送图像时出现错误的问题

- 修复了内容为“null”的工具调用消息被错误拒绝的问题

- 修复了预设上的辅助点击有时不起作用的问题

- 修复了 RAG 不工作的问题

- 修复了聊天和文件夹无法拖动到侧边栏根目录的问题

- 修复了计算令牌/使用嵌入模型时的内存泄漏问题

- 修复了安装程序在高 DPI 屏幕上模糊的问题

- 修复了安装新运行时后,模型的搜索过滤器未更新的问题

- 修复了搜索“Qwen VL”未给出正确结果的问题

- 修复了应用程序仍在初始化时模型无法加载的问题

- 修复了聊天页面会软锁定的问题

- 修复了聊天侧边栏滚动条长度与内容高度不同步的问题

- 修复了运行时删除不起作用的问题

- 修复了删除聊天有时会导致应用程序软锁定的罕见错误

- 修复了 lms 加载命令

- 修复了 lms 卸载和 lms 状态不适用于嵌入的问题

- 修复了启用详细日志记录时请求日志记录的问题(服务器)

- 修复了关闭提示和响应日志记录时,某些请求/响应未被编辑的问题

- 修复了下载恢复功能

- 修复了 UI 元素上的更多辅助功能标签

- 修复了拖放文件附件不起作用的问题

- [MLX] 修复了导致某些模型性能下降的错误

- 修复了应用程序无法在某些 Linux 发行版上启动的问题

- 修复了辅助功能按钮标签(以前显示 Object object)

- 修复了没有聊天模板(包括嵌入模型)的模型无法索引的错误

- 修复了 API 请求中传递空或 null 工具数组被视为未提供工具的问题

- 修复了 API 请求中助手消息中传递空或 null tool_calls 数组被视为模型未进行工具调用的问题

- 修复了文件附件导致错误的问题

- 修复了长聊天名称导致聊天操作按钮在侧边栏中被挤压的问题

- Huggingface 模型搜索的候选修复,应用程序内下载始终无法完成(“fetch failed”)

- 修复了从 Microsoft Word 粘贴文本时出现粘贴图像错误的问题

- 修复了 GGUF 模型的结构化输出问题 lmstudio-bug-tracker/issues/173

- 修复了 1-2 个 CPU 核心的机器出现 CPU 线程过低错误的问题

- 修复了启用服务模式时应用程序内更新的问题

- 修复了客户端应用程序生命周期中的 JIT 加载问题

更多

- 下载适用于 macOS、Windows 或 Linux 的最新 LM Studio 应用程序。

- 如果您想在工作场所使用 LM Studio,请联系我们:LM Studio @ Work

- 如需讨论和社区支持,请加入我们的 Discord 服务器。

- LM Studio 新用户?请访问文档:文档:LM Studio 入门。