文档

入门

LM Studio 入门

入门

LM Studio 入门

在 LM Studio 中下载并运行 Qwen、Mistral、Gemma 或 gpt-oss 等大型语言模型。

请仔细检查您的计算机是否满足最低系统要求。

信息

您有时可能会看到诸如开源模型或开放权重模型之类的术语。不同的模型可能在不同的许可证和不同程度的“开放性”下发布。为了在本地运行模型,您需要能够访问其“权重”,这些权重通常以一个或多个以.gguf、.safetensors等结尾的文件形式分发。

开始运行

首先,安装最新版本的 LM Studio。您可以从此处获取。

设置完成后,您需要下载您的第一个大型语言模型(LLM)。

1. 下载 LLM 到您的计算机

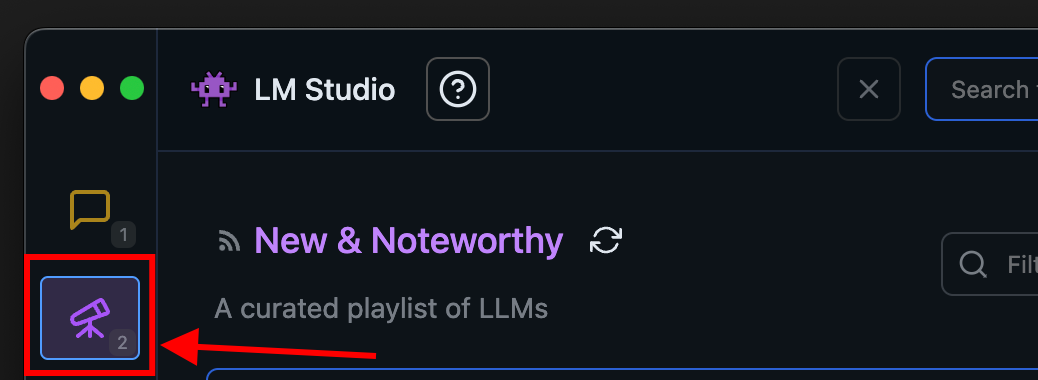

前往“发现”选项卡下载模型。选择一个精选选项,或按搜索查询(例如"Llama")搜索模型。有关下载模型的更详细信息,请参阅此处。

LM Studio 中的“发现”选项卡

2. 将模型加载到内存

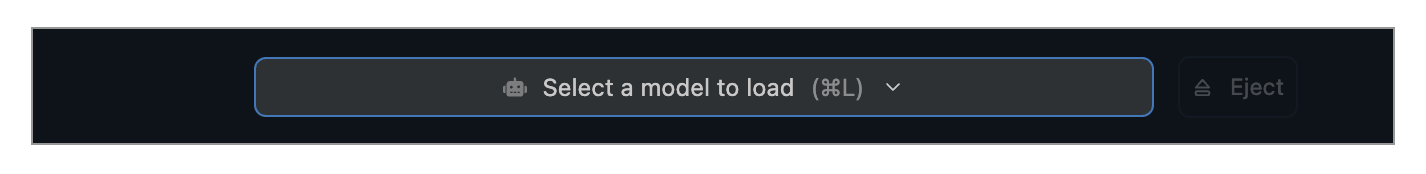

前往聊天选项卡,然后

- 打开模型加载器

- 选择您已下载(或旁加载)的模型之一。

- (可选)选择加载配置参数。

在 macOS 上使用cmd + L,在 Windows/Linux 上使用ctrl + L快速打开模型加载器

加载模型意味着什么?

加载模型通常意味着分配内存,以便在计算机的 RAM 中容纳模型的权重和其他参数。

3. 聊天!

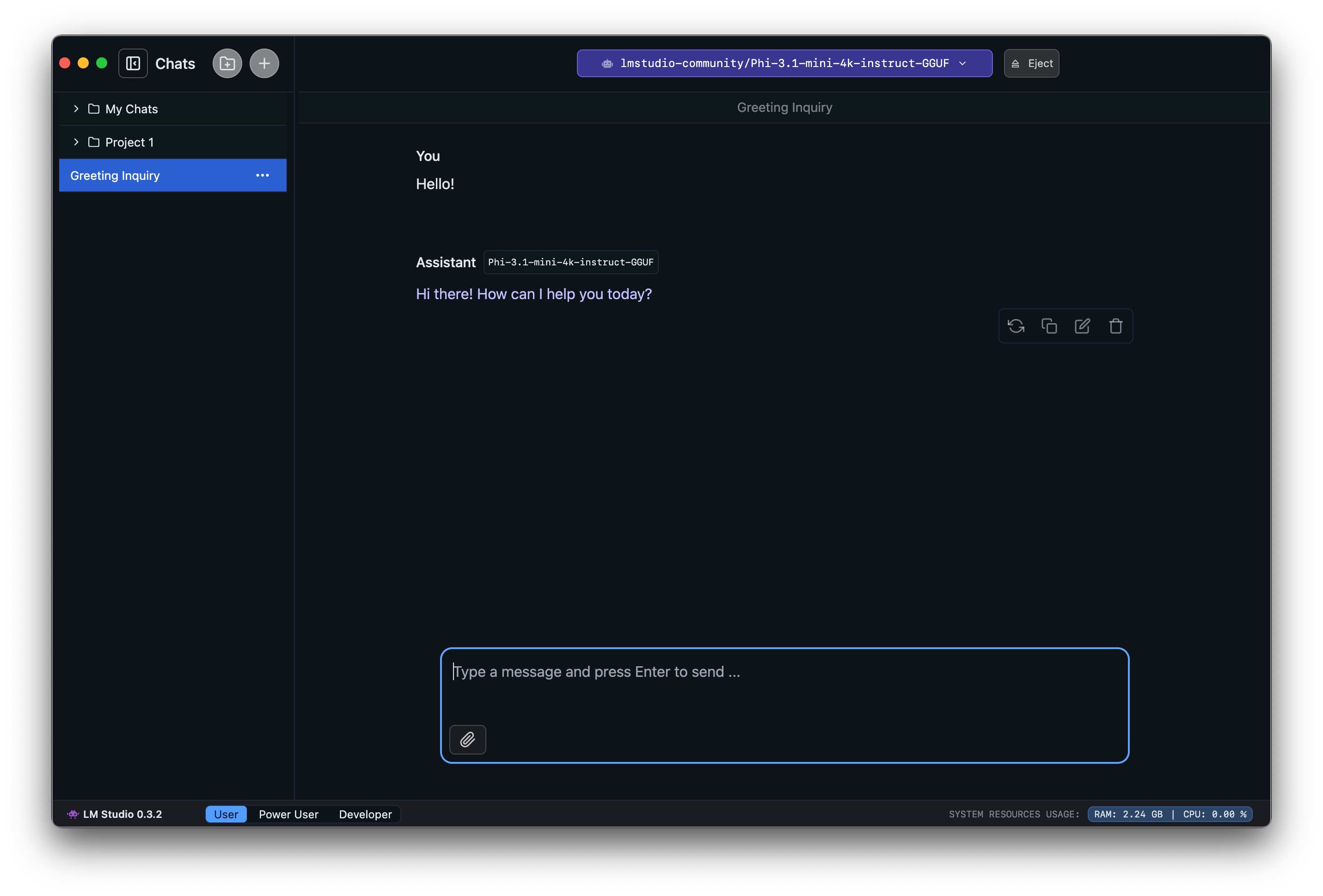

模型加载后,您可以在“聊天”选项卡中与模型开始对话。

macOS 上的 LM Studio

社区

在 LM Studio Discord 服务器上与其他 LM Studio 用户聊天,讨论大型语言模型、硬件等。

本页的源代码可在 GitHub 上找到